-

Comunicación

Crónica del desorden global

por Anna I. López

La inteligencia artificial: ¿una amenaza para la democracia?

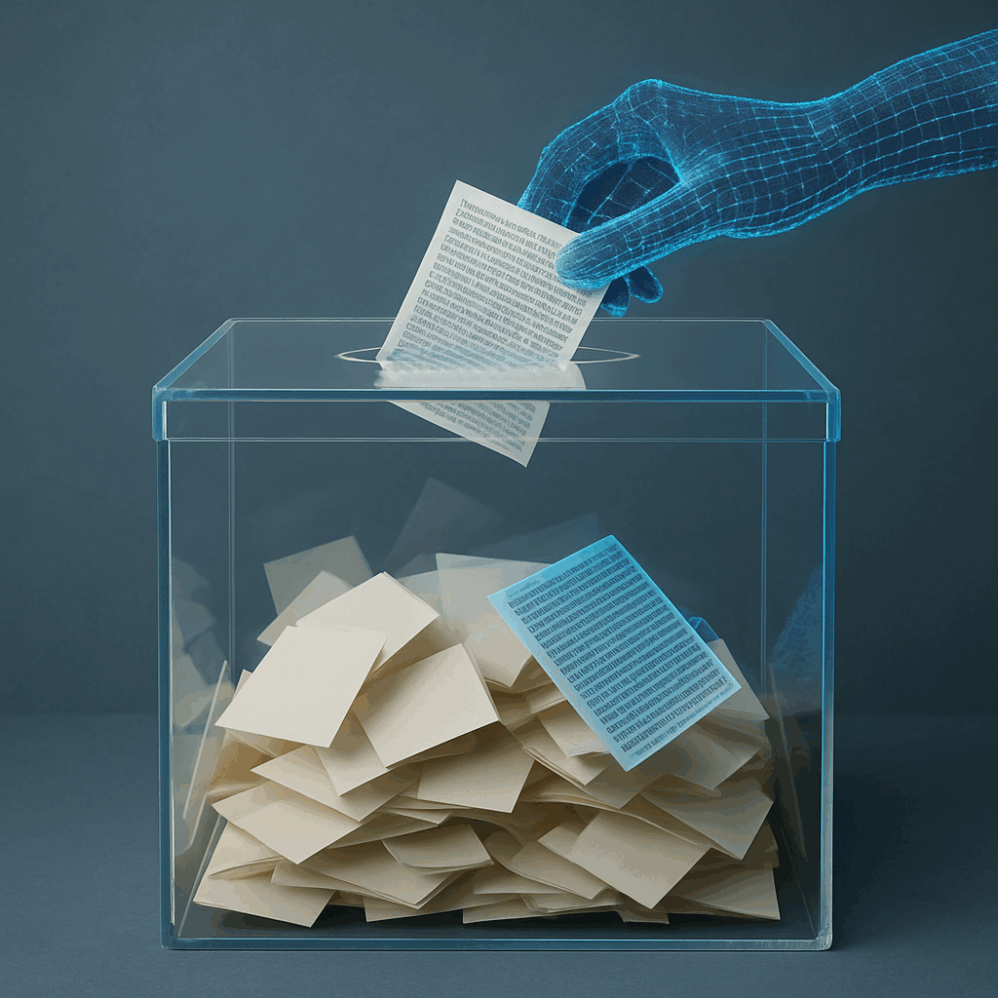

La irrupción de la inteligencia artificial generativa, personificada por el meteórico ascenso de ChatGPT, que alcanzó los 100 millones de usuarios mensuales en apenas un mes, ha catalizado una transformación sin precedentes en sectores tan diversos como el periodismo, las finanzas y la medicina. Sin embargo, más allá de sus promesas de progreso, esta tecnología emergente plantea una serie de desafíos políticos que son, según los expertos, inmediatos y graves. No estamos hablando de escenarios apocalípticos lejanos ni de debates pedagógicos sobre el uso académico, sino de una amenaza tangible a los pilares fundamentales de la gobernanza democrática: la representación, la rendición de cuentas y, en última instancia, la confianza social y política.

El núcleo del problema reside en la capacidad de la IA generativa para producir volúmenes ingentes de contenido que se ocultan a simple vista. Este torrente de información, que puede variar desde el disparate sin sentido hasta la desinformación maliciosa, amenaza con inundar nuestro panorama mediático y de comunicación política.

En primer lugar, la IA generativa interfiere con la representación democrática. Para que un gobierno sea receptivo a las preferencias de sus ciudadanos, los funcionarios electos deben ser capaces de discernirlas. Tradicionalmente, la correspondencia escrita ha sido crucial para que los legisladores se mantengan al tanto de las tendencias en sus distritos. No obstante, en la era de la IA, las señales enviadas por las comunicaciones electrónicas pueden ser profundamente engañosas. Actores maliciosos pueden generar falsas opiniones en el electorado a gran escala, creando mensajes únicos que adoptan posturas sobre una multitud de temas. Un experimento de campo de 2020 demostró que los legisladores tenían dificultades para distinguir entre las comunicaciones escritas por humanos y las generadas por IA, respondiendo de manera indistinguible en varios temas. Esta realidad podría sesgar la percepción de los legisladores sobre qué temas son realmente importantes para sus electores. De forma similar, el proceso de consulta pública, donde los ciudadanos influyen en las acciones del estado regulador, podría volverse obsoleto si las plataformas de elaboración de normas electrónicas se inundan con infinitos comentarios generados por IA que promueven una agenda específica. Como precedente, la Comisión Federal de Comunicaciones de EE. UU. fue inundada en 2017 con más de ocho millones de comentarios (muchos de ellos no únicos) abogando por la derogación de la neutralidad de la red, un esfuerzo que la tecnología de IA actual podría replicar con mayor sofisticación, haciendo la detección mucho más difícil.

La propaganda generada por IA es tan creíble como la escrita por humanos, y combinada con nuevas capacidades de microsegmentación, podría revolucionar las campañas de desinformación.

En segundo lugar, la IA socava la rendición de cuentas democrática. Para que la rendición de cuentas en las urnas sea efectiva, los votantes necesitan acceso a información precisa sobre las acciones de sus representantes. La preocupación por el sesgo en los medios no es nueva, pero la IA generativa exacerba esta amenaza a la integridad electoral. Las campañas de influencia extranjera, como las observadas en las elecciones presidenciales de EE. UU. de 2016, ya explotaron nuevas tecnologías para difundir información engañosa. Sin embargo, a diferencia de aquellos esfuerzos, donde las publicaciones tenían a menudo errores gramaticales reveladores, ChatGPT equipara a cada usuario con un «hablante nativo». Esta tecnología ya se está utilizando para crear sitios web de spam y reseñas falsas, y las investigaciones sugieren que la propaganda generada por IA es tan creíble como la escrita por humanos. Combinado con nuevas capacidades de microsegmentación, esto podría revolucionar las campañas de desinformación, distorsionando la percepción de los votantes sobre el desempeño de sus funcionarios hasta el punto de que las elecciones dejen de ser un mecanismo genuino de rendición de cuentas.

Un bombardeo constante de contenido generado por IA de dudosa veracidad podría tener graves consecuencias para la confianza en los medios y, por ende, en el gobierno.

Finalmente, la IA amenaza con erosionar la confianza social y política, la moneda más importante de cualquier sistema político. A medida que el contenido inauténtico –texto, imágenes y vídeos– prolifera en línea, la gente podría simplemente no saber qué creer, desarrollando una desconfianza generalizada en todo el ecosistema informativo. La confianza en los medios ya es baja, y la IA podría socavar aún más los niveles ya peligrosamente bajos de confianza en el gobierno. Esta confianza es esencial; impulsa el compromiso cívico, refuerza la fe en las instituciones políticas y promueve los valores democráticos, sirviendo de baluarte contra el retroceso democrático. Para las élites políticas, la capacidad de respuesta exige confiar en que los mensajes recibidos representan las preferencias legítimas de los electores, no una campaña coordinada para distorsionar la opinión pública. Y para los ciudadanos, la confianza fomenta la participación y la resistencia frente a las amenazas. Un bombardeo constante de contenido generado por IA de dudosa veracidad podría tener graves consecuencias para la confianza en los medios y, por ende, en el gobierno.

Ante este panorama, es imperativo formular medidas profilácticas. La primera es el desarrollo y la implementación de herramientas de detección de IA. Las mismas redes neuronales que generan contenido pueden entrenarse para identificar los patrones distintivos del lenguaje y las estructuras de texto creadas por IA. Aunque estas herramientas deben adaptarse constantemente, pueden ofrecer una solución parcial.

En segundo lugar, las plataformas de IA generativa deben asumir su responsabilidad. Como las redes sociales han aprendido a lo largo de los años, tienen una obligación en términos de qué contenido producen, cómo lo enmarcan y qué tipo de contenido está prohibido. Empresas como OpenAI ya están colaborando con investigadores para democratizar los valores codificados en sus algoritmos, decidiendo qué temas deben estar fuera de los límites o cómo enmarcar posturas políticas. Es crucial que estas plataformas colaboren estrechamente con funcionarios electos para crear algoritmos responsables y transparentes. El reciente compromiso voluntario de siete importantes empresas de IA con salvaguardias, en coordinación con la Administración Biden, es un paso en la dirección correcta.

Debemos adoptar la práctica de verificar la autenticidad y la exactitud factual del contenido digital en diferentes medios y contrastar cualquier dato dudoso.

Por último, las campañas de alfabetización digital son fundamentales. Así como las redes neuronales aprenden, los propios lectores pueden desarrollar un discernimiento para identificar el contenido generado por IA. Los modelos de lenguaje extensos suelen tener un estilo algo formulista y predecible. Estudiar este tipo de lenguaje puede ayudar a las personas a reconocer las pistas de contenido falso. Debemos adoptar la práctica de verificar la autenticidad y la exactitud factual del contenido digital en diferentes medios y contrastar cualquier dato dudoso. En un mundo donde «ver para creer» ya no es suficiente, es esencial un enfoque de confiar pero verificar», ejerciendo disciplina para establecer la credibilidad del material consumido.

Las nuevas tecnologías como la IA generativa prometen enormes beneficios. Sin embargo, sus riesgos políticos son innegables. Con una comprensión adecuada de estos peligros y la implementación de medidas de protección, podemos preservar y fortalecer nuestras sociedades democráticas, incluso aprovechando la IA para identificar contenido falso y comprender mejor la voluntad popular.

Lecturas recomendadas

«La IA lo revoluciona todo e influye en nuestras democracias» – International IDEA (2025). Análisis sobre cómo la IA permite campañas de desinformación a gran escala que distorsionan el debate público y erosionan la confianza ciudadana. International IDEA

«La amenaza que representa la IA generativa para la democracia» – Common Cause (2024). Discusión sobre cómo las deepfakes producidas con IA se utilizan para difundir desinformación y suprimir votos. Common Cause

«Democracia e Integridad Informativa: Inteligencia Artificial, Desinformación y Violencia Digital» – International IDEA (2024). Informe que ofrece un diagnóstico profundo sobre los desafíos que enfrenta la democracia en la era digital, centrando su análisis en la desinformación, la inteligencia artificial y la violencia digital. International IDEA

«Cómo la inteligencia artificial amenaza las elecciones libres y justas» – Brennan Center for Justice (2025). Análisis sobre cómo la IA puede afectar la integridad electoral y las medidas necesarias para mitigar estos riesgos. Brennan Center for Justice

«La IA como herramienta para combatir la desinformación» – Revistas Científicas USP-CEU (2025). Estudio sobre el papel de la IA en la generación, difusión y detección de fake news, y su impacto en la comunicación social. revistascientificas.uspceu.com

Magazine

Magazine